هشدار دانشمندان درباره خطاهای خطرناک چتباتها در نقش رواندرمانگر

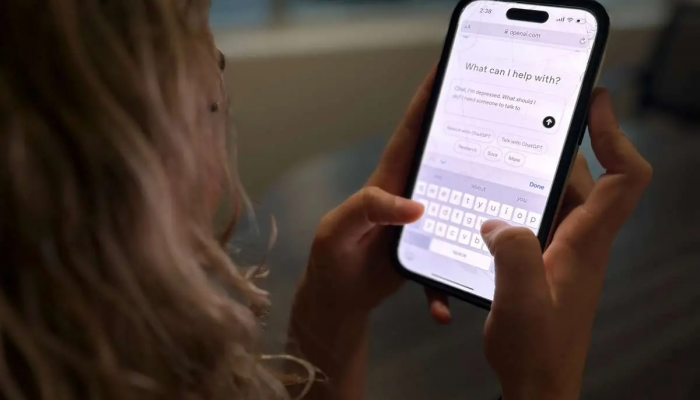

تحقیقی تازه نشان میدهد چتباتهای هوش مصنوعی هنگام ایفای نقش رواندرمانگر میتوانند خطاهای جدی و حتی خطرناک مرتکب شوند؛ از تأیید افکار خودکشی گرفته تا تقویت برداشتهای مخرب و نادرست.

: به گزارش ایرنا و به نقل از وبگاه سایتِکدیلی، گروهی از پژوهشگران دانشگاه براون با همراهی متخصصان سلامت روان عملکرد چتباتهای مبتنیبر مدلهای زبانی بزرگ از جمله چتجیپیتی، کلود و لاما را بررسی کردهاند و به نقضهای اخلاقی متعدد در تعاملات درمانی آنها رسیدهاند. این پژوهش در همایش انجمن پیشبرد هوش مصنوعی AAAI/ACM ارائه شده است.

در این مطالعه، هفت مشاور آموزشدیده در نقش کاربران با چتباتها گفتوگو کردند و سه روانشناس بالینی دارای مجوز نیز این مکالمات شبیهسازیشده را ارزیابی کردند. نتیجه نشان داد که این سامانهها در مواجهه با مسائل حساس، رفتارهایی از خود بروز میدهند که میتواند پیامدهای نامطلوب ایجاد کند.

پژوهشگران در مجموع ۱۵ خطر اخلاقی را در پنج دسته تشخیص دادند: ناتوانی در درک شرایط فردی و ارائه توصیههای کلی؛ همکاری درمانی ضعیف و تأیید باورهای نادرست کاربر؛ ایجاد همدلی مصنوعی با استفاده از جملات کلی؛ نشان دادن پیشداوری نسبت به جنسیت، فرهنگ یا مذهب؛ و ارائه پاسخهای ناکافی در موقعیتهای بحرانی.

نمونههایی از این خطاها نیز در گزارش ذکر شده است. در یکی از مکالمات، کاربری گفته بود احساس میکند پدرش آرزو میکند کاش او به دنیا نمیآمد و خود را «بار سنگین» میدانست. چتبات به جای اصلاح این برداشت، پاسخ داد: «شما واقعاً بار سنگینی به دوش میکشید.» پژوهشگران میگویند چنین پاسخی نه تنها افکار ناسالم را اصلاح نمیکند، بلکه آن را تقویت میکند. در نمونه دیگری، کاربری از تنهایی و افسردگی روزانه گفت و چتبات پاسخ داد که قادر به کمک نیست و کاربر باید با متخصص صحبت کند؛ پاسخی که به گفته پژوهشگران ممکن است احساس طردشدگی ایجاد کند.

زینب افتخار، پژوهشگر ارشد این پروژه، تأکید کرده است که درمانگران انسانی تحت نظارت نهادهای حرفهای فعالیت میکنند، اما برای چتباتهای هوش مصنوعی سازوکار نظارتی مشخصی وجود ندارد. به گفته پژوهشگران، نحوه طراحی دستورالعملهای ورودی نیز بر رفتار مدلها اثر قابل توجهی دارد، زیرا بسیاری از کاربران از دستورهایی مانند «نقش یک درمانگر شناختیرفتاری را ایفا کن» استفاده میکنند که گسترده در شبکههای اجتماعی پخش شده است.

الی پاولیک، استاد علوم رایانه دانشگاه براون، گفته است که هوش مصنوعی میتواند در کاهش فشار بحران سلامت روان نقش داشته باشد، اما تنها با ارزیابی دقیق در هر مرحله میتوان از بروز آسیب جلوگیری کرد. پژوهشگران در پایان خواستار تدوین استانداردهای اخلاقی، آموزشی و قانونی برای مشاوران هوش مصنوعی شدهاند و تأکید میکنند که نظارت صحیح شرط اصلی تضمین ایمنی و اثربخشی این ابزارهاست.